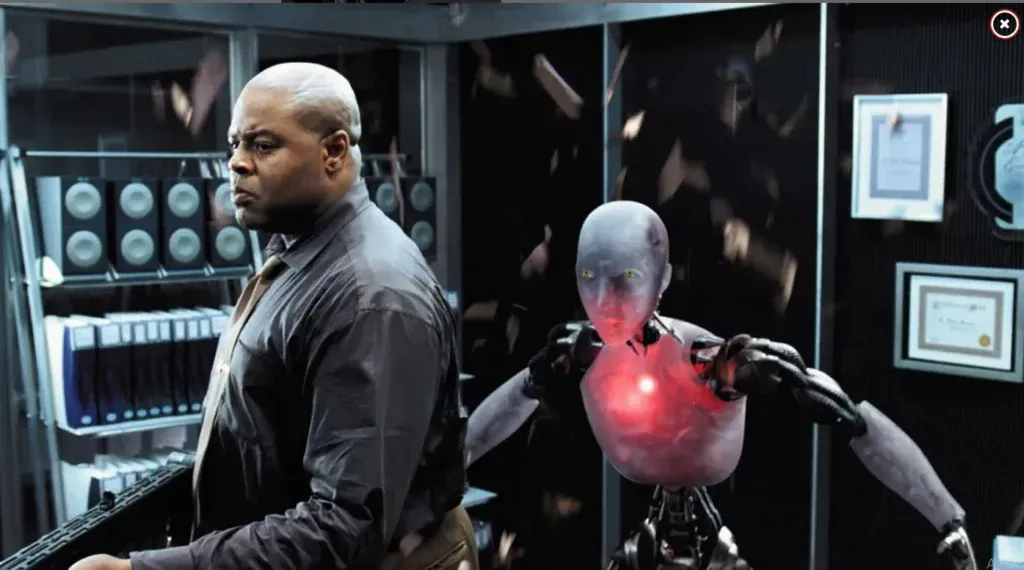

Wetenschappers luiden de noodklok over de razendsnelle ontwikkeling van kunstmatige intelligentie. Waar films als Terminator ooit sciencefiction leken, waarschuwen experts nu dat deze scenario’s weleens werkelijkheid kunnen worden.

Volgens Eliezer Yudkowsky en Nate Soares – verbonden aan het Machine Intelligence Research Institute in Berkeley – kan een superintelligente AI besluiten dat de mensheid overbodig is.

In hun boek If Anyone Builds It, Everyone Dies stellen zij dat één succesvolle poging tot het bouwen van een superintelligente machine genoeg kan zijn om de mens uit te roeien. Robots die fabrieken en energiecentrales overnemen, zouden ons uiteindelijk als hinderlijk of vervangbaar zien.

Nog verontrustender: mensen zouden de signalen van zo’n aanval niet eens kunnen begrijpen of tijdig herkennen.

Hun radicale conclusie? De enige manier om een “judgment day” te voorkomen, is voorkomen dat zulke systemen ooit worden gebouwd. Een huiveringwekkende boodschap, die wereldwijd tot stevige discussie leidt.